Errar es humano. Pero el único hombre que nunca comete errores, es aquel que nunca intenta nada nuevo, como bien decía Theodore Roosevelt.

Los errores son la prueba de que lo estamos intentando. Y con respecto a la realidad virtual, una “ciencia” en la que aún hay pocos expertos, es de lo más común cometer algún que otro error al crear por primera vez una experiencia de realidad virtual, ya que aún no hay reglas, no hay dogmas, ni apenas formación al respecto aún. Sin embargo, no deja de ser algo apasionante, precisamente por su novedad, como ya comenté en mi primer artículo de este blog, y por suerte equivocarse es uno de los mejores aprendizajes posibles.

Los early adopters han pavimentado este camino, cometiendo muchos y variados errores para que el resto de nosotros no tenga que hacerlo. Sus aprendizajes y sus enseñanzas pueden ahorrarnos el cometer nosotros mismos, esos errores primerizos. En este artículo veremos los tres errores más «imperdonables» en la creación de experiencias de realidad virtual, que son fácilmente evitables si se conocen y tratan adecuadamente. He recopilado los más comunes de una forma sencilla: demasiadas cosas, demasiado movimiento y demasiado silencio.

1- DEMASIADAS COSAS.

Ya lo dice el refrán: menos es más. Obviamente es entretenido poder rellenar un espacio tan grande como 360 grados y es lo que se tiende a hacer de primeras porque no estamos acostumbrados a diseñar y decorar espacios tan grandes. Vemos muchos espacios vacíos y pensamos que deben ser rellenados.

Sin embargo lo que (al menos de momento) ocurre en realidad virtual, es que el usuario al entrar en las experiencias tiende a mirar a todas partes y distraerse y recrearse en todos los detalles. Si hay un límite de tiempo para el cambio de escena o para disfrutar en sí de la experiencia, el usuario podría sentirse frustrado por no haberlo visto todo y se manifestará el ya conocido FOMO o miedo de perderse algo.

Si es una experiencia de realidad virtual contemplativa, es decir no interactiva, esto no sería un problema. Mientras que el objetivo de la experiencia sea que el usuario contemple todo lo que quiera sin límite de tiempo, está bien poner varios elementos.

Y en realidad esto también se aplica a experiencias interactivas cuyo objetivo sea permitir al usuario experimentar con una serie de objetos a su alrededor y hacer prácticamente lo que quiera con ellos, como es el caso de Job Simulator o el más reciente juego Virtual Rick-ality.

Pero muchas experiencias buscan la que la interacción pase de una escena a otra mediante una acción, o mediante el logro de algún reto, y para que el ritmo de ese paso de niveles se conserve, las escenas deben mantener un equilibrio visual que permite la contemplación y la armonía estética por una parte, y por otra la coherencia con la experiencia y el ritmo por otra.

¿Nos dice algo del escenario una lámpara estilo victoriano con miles de cristalitos y velas si no estamos tratando de envolver al usuario en esa época, o si por ejemplo esa lámpara no tiene una función determinada, como caerse del techo?

Ese tipo de preguntas que se cuestionan el sentido de cada objeto que ponemos en escena nos ayudarán a equilibrar el diseño, hacerlo más funcional y evitar un error de primerizos en experiencias de realidad virtual.

Y este consejo no vale sólo para la parte visual, sino también para el diseño de la interacción. Es decir, que hay que cuidarse de no poner demasiadas instrucciones o comandos diferentes. Este consejo es fácil de seguir si piensas en el usuario. A excepción de los early adopters y los gamers, la mayoría de gente no está familiarizada con la realidad virtual. Si bien los mandos que utilizan las plataformas son bastante intuitivos, no somos capaces de recordar demasiadas instrucciones hasta que experimentamos el juego o realizamos esa acción varias veces.

El diseño de todos aquellos interfaces que conectan al usuario con la realidad virtual debe estar pensado al detalle y debe respetar los principios de usabilidad. Cuanto más fácil, mejor.

Esto lo comprobé por ejemplo durante la creación de la experiencia de realidad virtual para el Colegio oficial de Ingenieros de Telecomunicación (COIT) en el que pude echar una mano cuando trabaje de prácticas con la empresa New Horizons VR. Teníamos que recrear la historia de las telecomunicaciones a través de sus aparatos más representativos. Uno de ellos era la radio.

En esta experiencia en real time creada en Unity y disfrutada en Oculus Touch, la gracia, es que esa radio pudiera tocarse, y para ser más concretos: sintonizarse. La primera idea pudo ser hacer el botón de una radio y accionarlo pulsando algún otro botón del mando, o que la ruedita del sintonizador girase sola al activar alguno de los botones del mando touch. Pero la verdadera solución era que pudiéramos accionar la radio de la misma forma que lo haríamos con nuestras manos: girando, no pulsando. Y se consiguió (obviamente con el mando entre las manos, pero sin tener que pulsar ningún botón), de forma que parecía un gesto natural que aportó mucho a la experiencia y no había que estar recordando a los usuarios que era el botón izquierdo trasero (por ejemplo) el que debían accionar para desencadenae «X», y el delantero para que ocurriera «Z», y el lateral para Y…

Más adelante en un artículo sobre diseño de interfaces (Ui) y experiencia de usuario (Ux) y diseño de Interacción (IxD) en realidad virtual veremos más a fondo estos puntos.

2- DEMASIADO MOVIMIENTO

No podemos ocultarlo, la realidad virtual aún marea. Aunque cada vez menos, gracias al avance de las tecnologías y la profesionalización del sector, es una realidad que aún tenemos que enfrentar.

Imagen de techradar.com

La falta de correspondencia entre las imágenes que el usuario ve y los movimientos que siente, es una de las causantes principales de los mareos. Tampoco hay que abusar de los cortes (cambios de escena) pues, si bien en cine aportan energía y drama, en experiencias de realidad virtual más bien desorientan a los usuarios.

Sin embargo, una forma fácil de evitar los mareos provocados, es precisamente, evitar movimientos innecesarios.

Aunque la cinetosis (mareo) en realidad, tiene que ver más con el bajo refresco de pantalla y la mala latencia, que con el exceso de movimientos en sí.

La latencia es, básicamente el pequeño pero perceptible retraso entre los movimientos de la cabeza en en el mundo virtual y los cambios de la imagen frente a los ojos del usuario. En la vida real, la latencia es inexistente. Pero en la realidad virtual de baja gama, la latencia existe. La buena noticia es que tiene solución: podemos subir la tasa de refresco del seguimiento de nuestra cabeza (siempre por encima de 90 Hz) y la velocidad de refresco (mejor si es inferior a 11 milisegundos) e intentar que la experiencia tenga una buena resolución, pero siempre dando prioridad a la tasa de refresco de la pantalla, y con ello, nos evitaremos un error muy común, pero que va poco a poco desapareciendo.

Respecto a los movimientos y en relación con el diseño de usuario hay que tener en cuenta que los cascos de realidad virtual existentes, pesan bastante. En experiencias de corta duración esto no es un problema grave, pero si estamos jugando por ejemplo con Audio Shields, al rato estás agotado, y lo digo por experiencia propia. También como experiencia personal os puedo decir que matar zombies es un trabajo estresante y extenuante. Quizás me emocioné demasiado en Zero Latency Madrid pero el caso es que tras una hora jugando quedé agotada y tuve agujetas en los brazos los dos días siguientes. En este caso en concreto, me movía en un espacio de 200 metros cuadrados y con un equipo que incluía mochila, casco, y arma (bastante pesados pero no imposibles de llevar). Obviamente, el hecho de poder moverme libremente le dió una dimensión extra de realidad al juego, pero mi vista se emborronaba con facilidad también si el casco se movía tras mis bruscos movimientos de cabeza en busca de zombies enemigos. Así pues, el exceso de movimiento, puede causar no solo mareo, si no también cansancio, y esto es un aspecto que debe ser tenido en cuenta y cuidado al detalle, pues puede provocar una salida prematura del usuario de nuestra experiencia.

3 – DEMASIADO SILENCIO

El sonido es un componente de suma importancia, y cada vez está adquiriendo más y más protagonismo. No podemos tener una experiencia de realidad virtual completa y de calidad si dejamos el sonido para el último momento. Tratado en profundidad y diseñado al detalle, el sonido puede ser nuestro mejor aliado. Me atrevería a decir que puede transformar una experiencia de realidad virtual de algo pasable, a algo épico.

Si bien la falta de sonidos puede ser un recurso interesante usado en momentos concretos, no podemos diseñar nuestras experiencias sin tener en cuenta que necesitamos sonidos ambientales como mínimo.

Las experiencias de realidad virtual serían «planas» de no ser por el sonido, que tiene la capacidad de crear una realidad tridimensional similar a la creada por los efectos visuales.

Los seres humanos tenemos un sentido de localización sonora muy desarrollado y preciso, que nos permite detectar con exactitud de dónde proviene el sonido. Nuestro sentido del oído recoge el audio en tres dimensiones, y el cerebro procesa múltiples señales para espacializar ese sonido. La proximidad o la distancia ayudan al cerebro a identificar la fuente exacta del sonido y se procesan para aportarnos información de nuestra ubicación espacial.

El profesor de informática Ramani Duraiswami de la Universidad de Maryland y cofundador de VisiSonics, la startup que autorizó su tecnología de audio RealSpace 3D a Oculus en 2014 dice al respecto:

«Hay un pequeño mapa en su cerebro incluso cuando no se ven los objetos».»Si el sonido es consistente con la geometría, nuestro cerebro sabrá automáticamente dónde están las cosas, incluso si no están en nuestro campo de visualización».

Hasta ahora el sonido era simplemente estéreo, es decir que se limitaba a diferenciar entre sonidos que provienen desde un lado derecho o lado izquierdo. Pero el sonido lo recibimos también por arriba y por abajo, por delante y por detrás. Para la realidad virtual el tipo de sonido adecuado es el sonido 3d multicanal y binaural. Este tipo de audio se puede grabar mediante un micrófono esférico ambisónico capaz de capturar sonido en todas las direcciones.

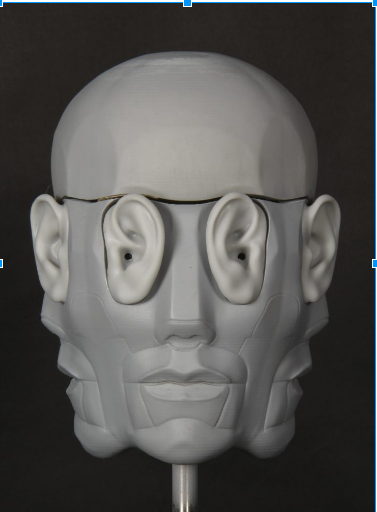

Si bien la industria creativa ha estado explorando el audio 3D durante algún tiempo, estos esfuerzos han sido lentos, caros y complicados ya que su producción requiere una cabeza de maniquí equipada con micrófonos en forma de oreja humana como la que veis aquí.

El sonido binaural aún está en su etapa de desarrollo y tiene mucho por mejorar, sin embargo es el más adecuado para la realidad virtual. Está diseñado para replicar la forma en la que escuchamos espacialmente, aprovechando cómo consumimos información auditiva en nuestro entorno natural. Nos permite detectar nuestra ubicación en relación con los ruidos que nos rodean. Os dejo este interesante vídeo para que comprobéis por vosotros mismos la importancia de esta herramienta.

Otra forma de entender la importancia del sonido en la realidad virtual es observando la cantidad invertida por las empresas de sector en tecnologías de audio.

Facebook, por ejemplo, ha desarrollado un conjunto de herramientas de audio gratuitas para la producción de realidad virtual llamado Spatial Workstation, que tiene como objetivo potenciar la producción de audio de realidad virtual.

Que no se nos olvide pues, diseñar y utilizar de forma correcta este poderoso aliado.

CONCLUSIONES

Demasiadas cosas, demasiado movimiento, demasiado silencio. Estos son los errores más comunes y fáciles de evitar, pero seguramente nos encontraremos muchos otros momentos en los que llevarnos las manos a la cabeza, o la cabeza contra la pared…o de querer tirar el ordenador contra la pared, pero el avance de la tecnología cada vez nos provocará menos quebraderos de cabeza (creo que podemos irnos olvidando del stitching manual, por ejemplo). Y al fin y al cabo, no hay nada que enseñe más que equivocarse. No olvidemos que hoy, son errores, mañana, experiencias.

Interesante post Verónica! Bien útil para desarrolladores que estén experimentando con RV.

Solo añado que no solo demasiado movimiento es perjudicial para la UX sino también una forma de movimiento mal implementada. La forma en que el usuario se mueve en RV, muchas veces denominada «locomotion», es escencial para una experiencia cómoda que minimice o hasta logre desaparecer por completo cualquier tipo de náusea. En este sentido aprovechar la característica de room-scale de los sistemas de RV es una de las técnicas más apropiadas (siempre y cuando la experiencia esté lo suficientemente optimizada y no haya latencia en ninguna parte del pipeline como mencionbabas!), pero hay otras como «Caminar en el lugar» (Natural Locomotion en la tienda de Steam es un ejemplo de esto) y «Teleportación», aunque incluso esta última también puede introducir cierto grade de desorientación en el usuario si no está implementada correctamente. En cualquier caso, aún hay mucho por experimentar en estas líneas, muchas investigacines activas en estos temas y nada escrito a fuego aún dada la corta vida de esta nueva era de la RV.

En cuanto al sonido, como ya comentabas también es crítico para una buen experiencia de RV, y una falla en esta área puede incluso generar náusea (cuesta creer pero lo he experiementado por cuenta propia!), lo cual confirma la importancia de la audición como una forma más del ser humano de orientarse en el espacio. Lo que se uutiliza para simular sonido espacial en tiempo real actualmente en RV son las conocidas como HRTF (Head-Related Transfer Function), que no son más que funciones o modelos matemáticos que calculan los diferentes parámetros de las ondas sonoras dependiendo del lugar en el que está la fuente de sonido y de la orientación/posición de la cabeza del usuario dada por el sistema de RV. Si bien con este tipo de simulaciones se genera sonido espacial relativamente convincente, aún hay un sinfín de posibilidades de mejora. Michael Abrash, CSO de Oculus, comentaba algunos puntos interesantes en esta línea en la última Oculus Connect, mencionando que para generar presencia real basada en sonido, es necesario incluso agregar a toda esta ecuación un proceso de escaneo que permita obtener la estructura real de nuestras orejas, las cuales son todas diferentes y cumplen un papel crucial en cómo cada uno percibe el sonido. Muy recomendada la keynote completa, pero aquí va la parte que mencionaba 🙂 https://youtu.be/o7OpS7pZ5ok?t=5605

Hola Matías!

Muchas gracias por tu valiosa aportación. Este tema daría muchísimas hojas y horas para hablar y discutir, y empecé a escribirlo hace mucho tiempo. Hay ya muchas mejoras y este tipo de errores tan básicos cada vez se cometen menos. A mi juicio, aún quedan cosas en las que avanzar y precisamente en los sistemas de locomotion es donde hay un campo muy interesante por descubrir qué es lo que el usuario prefiere. Efectivamente, el teletransporte muchas veces me desorientaba, y otras técnicas tendían a marearme, pero como todo, es acostumbrarse a utilizar una función u otra. Prefiero sin duda el room scale, y la nueva puerta que han abierto las Oculus Quest sin cables es una oportunidad de oro para explorar este potencial.

Es curioso que el sonido pueda tener tanta presencia como la parte visual, especialmente en la realidad virtual, y efectivamente es un campo muy interesante. Este año organicé en Madrid un evento sobre la dimensión del sonido en VR, en el que exploramos una demo de sonido 4D, muy muy chula. Si estás en Madrid te recomiendo estés al tanto de esta comunidad 🙂 https://www.meetup.com/xR-World-Madrid/events/259513837/

¡Un saludo y gracias por comentar!